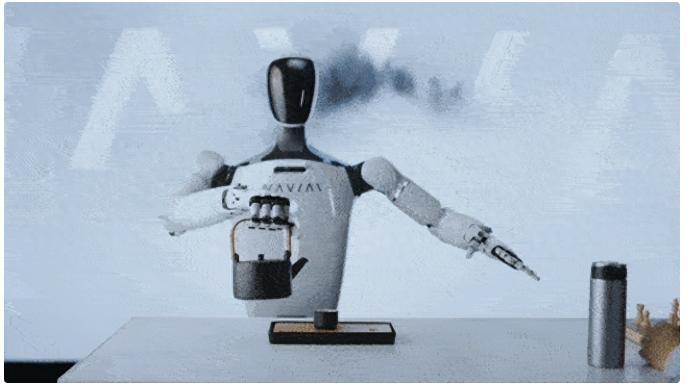

浙江人形发布具身智能标准,推动机器人行业新突破

人工智能领域的核心命题正在从“屏幕对话”转向“拥有身体的智能”。近期,中国首个《人形机器人与具身智能标准体系(2026版)》的发布,标志着这一产业迈入了规范化的新阶段。然而,在标准的背后,一个更深层次的问题依然存在:具身智能的瓶颈究竟在哪里?

尽管机器人可以听懂指令、看懂环境,但在细微动作上仍常常出错,例如插头歪一毫米就插不进、不知道如何绕开行人、拧螺丝时一用力就打滑。这揭示了一个核心困境:“听得懂、看得懂”并不等于“做得到、做得好”。机器人能够识别杯子,这属于语义知识的理解;但无法掌控抓握杯子的力度,这则是物理经验的缺失。

浙江人形的创新突破

浙江人形认为,行业的瓶颈不在于单一算法的改进,而在于两处根源:大规模高质量具身交互数据的匮乏,以及机器人“大小脑”能力体系的结构性断层。为应对这一现状,浙江人形从源头破局:通过多源数据融合体系实现低成本、高质量数据的大规模获取,并以“双螺旋”模型架构弥合“智能执行”的断层,解决物理经验的缺失问题。

浙江人形正在打通一条从“看得懂”到“做得好”的完整路径,让具身智能在真实场景中不断学习、进化、落地。

数据筑基:三源融合,毫米映射+毫秒级协同

数据是机器人的“教科书”。在具身智能数据方面,浙江人形采用“义务教育+高等教育+职业教育”的三源融合数据体系建设,融合视觉、听觉、力觉、触觉等物理交互的多模态数据,让机器人学得更快、看得更清、做得更准、适应性更强。

“人类数据 = 义务教育:通过大规模的人类行为数据预训练,模型获得通识理解能力,知道‘正常人会怎么做’。”

浙江人形的数据策略就像把模型培养成一个“通专兼备的复合型人才”。仿真数据通过真实场景的高保真重构与数据生成扩增,让模型在仿真中大规模反复练习,掌握可泛化精准作业的基础知识。真机数据通过多模态真机数据,在特定场景中高效完成真实任务,让模型“毕业即上岗”。

模型双擎:大脑与小脑的协同作业

当前具身智能大脑模型普遍采用VLM为骨干网络,继承其内在的语义泛化能力。然而,由于VLM的训练数据仅有语言和2D图像,缺少大规模的物理交互数据,大脑模型缺乏对空间位姿、几何结构等物理状态的认知能力,长程任务容易出现幻觉。

针对这一根本性缺陷,浙江人形提出“原生+借智”的模型策略。一方面增强VLM的能力,另一方面,模型原生支持从视力触位等物理交互数据中学习,完成多种可泛化高精准技能。

长序列导航任务决策与规划

浙江人形自研的具身智能SPIRE系统可灵活实现大小脑解耦和融合。C2L2模型负责环境认知、长程推理、任务拆解与自主纠错,而M2S2模型则负责将语义指令转化为高精准物理动作,融合多模态感知,保障实时性与安全性。

“精准倒液技能误差小于1ml,可适应透明液体。”

在康养服务场景中,机器人接到“倒出10毫升止咳糖浆”的指令后,大脑理解任务目标并自动拆解为多个子步骤,小脑则负责将大脑的决策转化为精准物理动作。

飞轮进化:数据与模型的双螺旋

浙江人形解决具身智能瓶颈的路径清晰而有力:一手抓数据,一手抓模型,让两者互为燃料、螺旋上升。数据是根基,模型是引擎。两者并非孤立存在,而是形成了一个持续加速的进化飞轮。

SPIRE系统在真实场景中每完成一次作业,就生成一条高质量的多模态感知-决策-行为数据,这些数据反哺给模型,让模型越训练越聪明;更聪明的模型又能完成更复杂的任务,产生更多高质量的数据。

“落地越广,进化越快——商业与技术由此实现同频共振。”

这不仅是技术的突破,更是中国在定义下一代物理智能的范式。真正的具身智能,不是写在代码里的预设程序,而是在一次又一次的抓取、装配、揉搓中,亲手长出来的经验与智慧。

展望未来,浙江人形将继续以“数据+模型”双轮驱动,深耕真实场景,携手全球生态伙伴,共同推动人形机器人从“能用”走向“好用”,从“专用”走向“通用”。