群核科技两篇论文入选CVPR 2026,揭示机器人空间理解新进展

近日,国际计算机视觉顶级会议CVPR 2026公布了论文录用结果,群核科技联合浙江大学、宇树科技共同完成的两篇论文成功入选。这两篇论文分别涉及具身智能终身学习框架和视觉语言模型空间推理基准。CVPR被誉为“计算机视觉界的奥斯卡”,每年吸引全球最前沿的AI研究成果。本届会议共收到16092篇有效投稿,最终录用4090篇,录用率为25.42%。

Arcadia框架:实现机器人具身智能的闭环学习

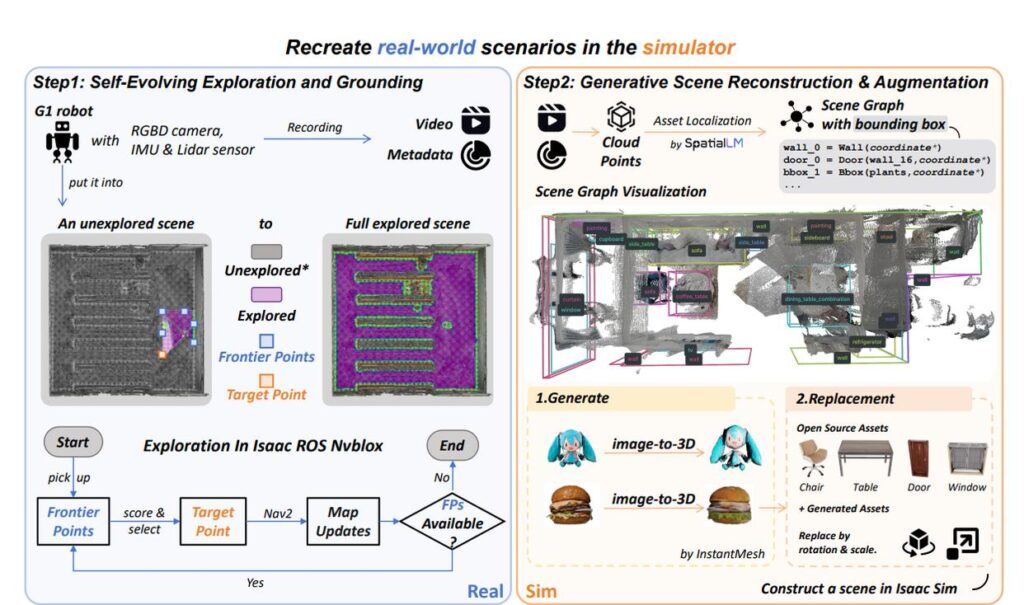

其中,论文《Arcadia: Toward a Full-Lifecycle Framework for Embodied Lifelong Learning》提出了一个面向具身智能终身学习的全生命周期闭环框架——Arcadia。该框架涵盖从数据收集、模型训练到实际部署后的自我进化和知识更新的完整过程,旨在探讨如何让机器人在不断变化的环境中“活到老学到老”。

在Arcadia框架中,群核科技发挥了其在空间重建和空间生成上的核心优势。依托其自研的SpatialLM大模型,系统能够高效解析机器人采集的多模态传感器数据为结构化语义信息。结合SpatialGen的空间生成能力,系统可自动生成丰富的仿真3D场景。随后,通过空间智能训练平台SpatialVerse进行物理特性模拟和数据扩增,为机器人提供了海量且物理一致的“训练场”。

实测数据显示,在宇树G1人形机器人的真实世界零样本测试中,Arcadia框架表现卓越:导航任务成功率达到46%,操作任务成功率达到27%。相较于NaVILA、OpenVLA等主流开源方案,其整体性能提升约3倍,尤其在多目导航与多物体协同操作等复杂场景中展现出显著优势。

SpatiaLQA基准:评估AI空间逻辑推理能力

另一篇论文《SpatiaLQA: A Benchmark for Evaluating Spatial Logical Reasoning in Vision-Language Models》则关注一个更基础的问题:AI是否真的理解空间?

当前的视觉语言模型在物体识别和抽象问答等任务上表现已相当出色,但在处理真实物理空间任务时,如遮挡关系、相对位置约束、操作顺序判断等,能力短板往往暴露无遗。例如,当机器人执行书架整理任务时,需要准确判断哪些书是支撑点、哪些摆件可独立移动,否则可能导致整排物品倾泻而下。

SpatiaLQA基准测试不仅提供了一套涵盖多种空间逻辑关系的评测数据集,更系统化定义了评价指标。群核科技的SpatialLM模型在该基准的构建中提供了重要技术支撑。

AI空间智能:从数字世界迈向物理世界的关键

过去几年,大模型主要改变的是数字世界。文本、图像和视频的生成与理解都已被AI深度重塑。然而,AI走进物理世界需要的核心能力是对物理空间的理解与交互,而这正是当前语言模型所欠缺的。

从这个角度看,此次入选的两篇论文分别触及了两个关键命题:Arcadia框架解决的是机器人“如何持续学习以适应真实世界”,而SpatiaLQA回答的是“如何衡量AI对空间逻辑的理解程度”。它们共同指向一个判断:空间智能正在成为AI从数字世界迈向物理世界的那块“关键跳板”。在这一过程中,群核科技始终是链接数字世界和物理世界的重要桥梁。

(本文来源:日照新闻网。本网转发此文章,旨在为读者提供更多信息资讯,所涉内容不构成投资、消费建议。对文章事实有疑问,请与有关方核实或与本网联系。文章观点非本网观点,仅供读者参考。)