MIT与英伟达合作开发TLT技术 提升AI模型训练效率

近日,麻省理工学院(MIT)与英伟达及其他机构合作,发布了一项名为“驯服长尾”(TLT)的技术,旨在显著提升大语言模型(LLM)在推理过程中的训练效率。据MIT News于2月26日的博文报道,这项技术能够将AI大模型的训练速度提高70%至210%。

推理大模型以其通过拆解步骤解决复杂问题的能力而闻名,但在强化学习(RL)的训练过程中,算力和能耗的消耗极为巨大。研究团队发现,生成多个备选答案的“推演”(rollout)阶段占据了高达85%的训练时间。由于不同处理器生成回答的长度不一,完成较快的处理器只能被迫闲置,等待其他处理器完成长文本任务,从而形成了效率瓶颈。

创新的“驯服长尾”技术

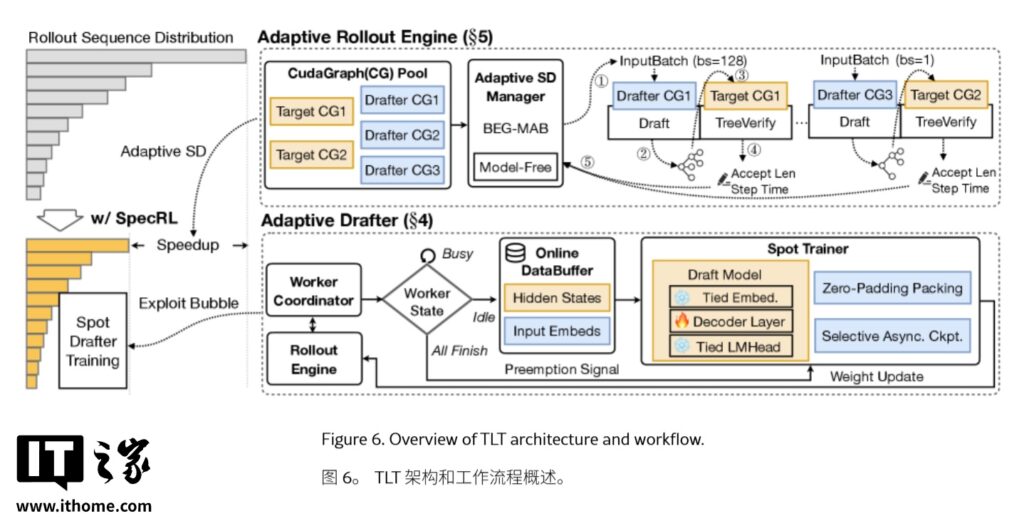

为了解决这一问题,MIT研究人员与英伟达、苏黎世联邦理工学院等机构联合提出了一种名为“驯服长尾”(TLT)的自适应解决方案。该方案的核心在于创新性地运用“投机解码”技术,即训练一个较小的“草稿模型”(drafter)来快速预测大模型的未来输出,随后由大模型批量验证这些猜测。

在传统的投机解码中,草稿模型通常只训练一次并保持静态。然而在强化学习中,主模型需要更新数千次,静态草稿模型会迅速失效。因此,TLT系统引入了“自适应草稿训练器”。一旦部分处理器完成短查询进入闲置状态,系统会立即调度它们实时训练草稿模型。

自适应推演引擎的作用

同时,“自适应推演引擎”会根据工作负载特征自动调整解码策略,确保草稿模型始终与目标大模型保持高度同步,且不增加额外算力开销。基于真实世界数据集的测试表明,TLT技术在保持模型准确率完全无损的情况下,将多个推理大语言模型的训练速度提升了70%到210%。

“TLT技术不仅提升了训练速度,还能在不损失准确率的前提下,将轻量级草稿模型作为免费的副产品,直接用于后期的高效部署。”

未来展望与影响

研究团队计划将该技术融入更多训练与推理框架中,以进一步降低AI开发成本并提升能源利用率。这一发展不仅有望改善当前AI模型训练中的效率瓶颈,还可能对整个行业的资源利用产生深远影响。

随着AI技术的不断进步,如何在提高效率的同时降低能耗成为研究人员关注的重点。MIT与英伟达的合作为这一领域带来了新的解决方案,未来或将引领更多相关技术的创新与应用。